Главное

• Распознавание эмоций в аудио и видео — это мультимодальная ML-задача, а не одна модель. Самые сильные системы объединяют лицо, голос, текст и иногда физиологические сигналы — каждый сигнал компенсирует слепые зоны остальных.

• Заявленная точность вводит в заблуждение. Бенчмарк-метрики 90–99% в продакшене падают до 60–80%, а в реальных условиях съёмки, при акцентах, окклюзии и демографическом сдвиге ошибка может превышать 70%.

• EU AI Act запретил большинство сценариев распознавания эмоций на рабочих местах и в образовательных учреждениях со 2 февраля 2025 года. Если ваш продукт затрагивает сотрудников или учащихся в ЕС — пересматривайте функционал или сворачивайте фичу: медицинские и safety-исключения сформулированы узко.

• Сначала покупайте, стройте только когда модель — это конкурентное преимущество. Готовые API (AWS, Google, Azure, Hume, MorphCast, Affectiva) подключаются за недели; собственный мультимодальный стек — это 4–9 месяцев с Agent Engineering, и он окупается только при действительно нестандартных данных, вертикали или требованиях к задержке.

• Этика — главный риск доставки. Согласия пользователей, аудиты на смещение, отчёты по точности в разрезе демографии и чёткий список «не использовать для…» — вот что удерживает фичу в продукте после запуска, а не архитектура модели.

Зачем Фора Софт написала это руководство

Распознавание эмоций в аудио и видео лежит на стыке трёх областей, в которых мы работаем уже два десятилетия: коммуникации в реальном времени, компьютерное зрение и прикладное машинное обучение. Мы строим продакшен-видеоплатформы для телемедицины, edtech, прямых трансляций, видеонаблюдения и корпоративных продаж — это ровно те вертикали, где вопрос «выглядит ли пользователь напряжённым, отстранённым или встревоженным?» превращается из исследовательской задачи в продуктовую функцию.

Наша практика AI-интеграции включает отдельную услугу Emotion Recognition Dynamics — мы встраиваем анализ лицевых аффектов в видео в реальном времени с помощью Azure Cognitive Services, OpenCV, MediaPipe, YOLO, PyTorch и TensorFlow и связываем сигналы с продуктовыми действиями. Платформа sales-интеллекта Meetric объединяет голосовые и поведенческие подсказки во время живых звонков и поднимает конверсию в сделку примерно на четверть. VocalViews, которым пользуются исследовательские команды Samsung, Google и Netflix, накладывает AI-анализ тональности на видеоинтервью на 30+ языках для более чем 800 000 верифицированных участников. Платформа видеонаблюдения V.A.L.T работает с HD-видео поведенческой аналитики на 2500+ камерах и обслуживает 50 000 ежедневных пользователей в правоохранительной сфере и медицинском образовании.

Дальше — руководство, которого нам не хватало в первый день: как такие пайплайны устроены на самом деле, какие датасеты и API имеют значение, что регулируется, что идёт не так в продакшене и какие цифры нужны покупателю, чтобы трезво принять решение build-vs-buy. Текст ориентирован на тех, кто будет выкатывать эту фичу, а не публиковать о ней статью.

Что такое распознавание эмоций в аудио и видео

«Распознавание эмоций» — общий термин для систем, которые выводят аффективное состояние (счастье, грусть, гнев, страх, удивление, отвращение, презрение, плюс непрерывные шкалы валентности и возбуждения) из видео с лицом, аудио речи, текстовых транскриптов или физиологических сигналов. В литературе это называют также аффективными вычислениями, распознаванием аффекта или мультимодальным распознаванием эмоций (multimodal emotion recognition, MER).

Коммерческая постановка задачи уже. Обычно команды выпускают одно из четырёх: классификацию лицевых выражений в видеопотоке, распознавание эмоций по речи (speech emotion recognition, SER) на микрофонном фиде, анализ тональности по транскрибированному тексту или мультимодальный классификатор со слиянием, объединяющий две-три из этих модальностей. Исследовательское поле добавляет биосигналы (ЭЭГ, пульс, кожно-гальваническая реакция), но они редко выходят из лабораторий, а EU AI Act теперь отдельно ограничивает их применение на рабочем месте.

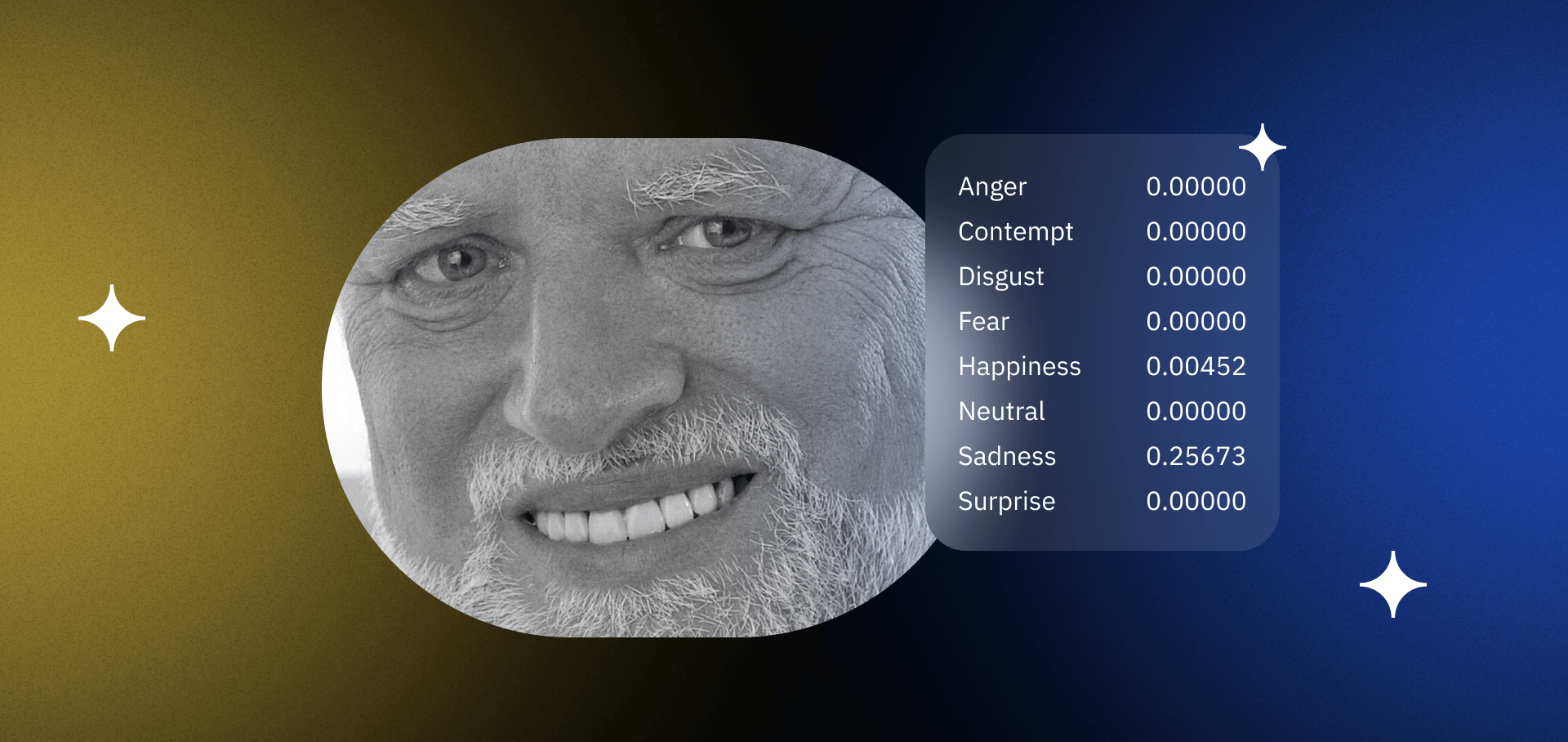

Полезная ментальная модель: пайплайн берёт аудиовизуальный фрагмент, извлекает признаки специфично для каждой модальности, прогоняет по одной модели на модальность, а затем либо устраивает мажоритарное голосование по выходам (позднее слияние), либо обучается совместно по всем сразу (раннее или гибридное слияние). Выход — вероятностное распределение по набору меток эмоций плюс уверенность. Что вы сделаете с этим распределением — оповестите клинициста, подскажете продажнику, направите звонок в саппорт, измените рекомендацию контента — это и есть сам продукт.

Планируете фичу с распознаванием эмоций и не знаете, с чего начать?

Расскажите нам про задачу — мы подскажем, подходит ли ваш кейс, с каких модальностей начать и какой реалистичный срок с учётом Agent Engineering.

Где распознавание эмоций реально окупается в 2026

Рынок аффективных вычислений, по прогнозам, вырастет примерно с 5,7 трлн ₽ в 2025 году до около 14,4 трлн ₽ к 2030 году при CAGR 20%, причём более половины узкой emotion-AI части приходится на контакт-центры и инструменты клиентского опыта. По-честному: не каждой вертикали это нужно, но в пяти направлениях — нужно, и именно там у нас закрываются реальные сделки.

1. Телемедицина и behavioral health. Мультимодальные сигналы эмоций — вокальная просодия, лицевые микровыражения, лингвистические маркеры в транскрипте — используются для выявления риска депрессии, тревожности и тяжести ПТСР во время виртуальных консультаций и помогают клиницистам выстраивать темп сессии. Быстрее всего применение растёт на платформах, которые уже работают с видеовизитами.

2. Мониторинг водителя и салона. Регуляторы вынуждают эту тему. Покупка Affectiva компанией Smart Eye в 2021 году за 5,5 млрд ₽ была мотивирована требованиями к автомобильному мониторингу салона; камеры в салоне теперь выводят состояние водителя, когнитивную нагрузку и признаки агрессивного вождения в составе систем безопасности.

3. Контакт-центры. Коучинг операторов на лету по эмоциям в речи — Cogito, Observe.AI, Uniphore — стал стандартным инструментом корпоративной поддержки. Одномодальный SER достигает 80–90% точности на хорошо подобранных тренировочных данных, и этого хватает, чтобы подталкивать поведение оператора.

4. Корпоративный sales-интеллект. Платформы вроде Gong, Chorus и наш собственный Meetric используют сигналы вовлечённости и просодии, чтобы коучить менеджеров, оценивать звонки и автозаполнять CRM. Meetric сообщает о 25% росте конверсии в сделку и 80–100% автозаполнении CRM у тех, кто его внедрил.

5. Маркет-рисёрч, тестирование медиа и UX. Анализ тональности видеоинтервью в масштабе, панели тестирования рекламы и исследования реакций в играх — это территория браузерных SDK для анализа лица (MorphCast, Realeyes): им не нужны серверные вызовы, и они обходят значительную часть споров о биометрических данных. VocalViews использует ровно эту схему на 185 000+ бизнес-пользователях.

Как устроен современный пайплайн распознавания эмоций

Каждая продакшен-система, которую мы строили или аудировали, повторяет одну и ту же пятиэтапную структуру: захват, предобработка, извлечение признаков, классификация, действие. Рисунок 1 показывает канонический пайплайн.

Рисунок 1. Канонический пайплайн мультимодального распознавания эмоций в продакшене.

Этап 1. Захват

Видео 10–30 кадров в секунду — этого достаточно: лицевые выражения медленны относительно частоты кадров. Аудио обычно 16 кГц моно PCM, буферизуется в кадры 20–100 мс для стримингового SER. Для низкой задержки в контакт-центре или мониторинге водителя предпочтительнее захват на устройстве: отправка сырой биометрии в облако повышает риски по GDPR и AI Act.

Этап 2. Предобработка

Для лица: детекция (MTCNN, RetinaFace, YOLOv8-face), выравнивание к канонической позе, нормализация освещения. Для аудио: voice-activity detection, обрезка тишины, шумоподавление, мел-спектрограмма или MFCC. Для текста: транскрипция продакшен-ASR (Whisper, Deepgram, AssemblyAI), затем токенизация. Именно на этом этапе выигрывается или проигрывается точность в реальных условиях: слабый детектор лица при плохом освещении превращает выход классификатора в бессмыслицу.

Этап 3. Извлечение признаков

Современные системы в основном end-to-end: CNN или Vision Transformer поверх выровненных кропов лица; энкодеры Wav2Vec2, HuBERT или Whisper поверх сырого аудио; BERT-подобный энкодер поверх транскрипта. Признаки, спроектированные вручную (Action Units для лица, просодия для голоса), по-прежнему важны для интерпретируемости и для edge-развёртываний с низкой задержкой, где ViT слишком тяжёл.

Этап 4. Классификация и слияние

Каждая модальность либо выдаёт собственное распределение меток (позднее слияние с последующим взвешенным усреднением или небольшой gate-сетью), либо признаки разных модальностей конкатенируются и проходят через совместный трансформер (раннее или гибридное слияние). Выбор — не вопрос религии; подробнее в разделе «Мультимодальное слияние» ниже.

Этап 5. Действие

Именно здесь живёт 90% продуктовой ценности — и 90% инженерных команд сюда недоинвестируют. Метка — это не фича. Метке нужны калибровка, временное сглаживание (скользящее окно 3–10 секунд), логика подавления, чтобы избежать алёрт-усталости, и состояние согласия для конкретного пользователя. Без этого слоя вы выкатите демо, а не продукт.

Четыре модальности — сравнение

У каждого входного сигнала свои сильные стороны, цена и режимы отказа. В таблице ниже — компромиссы, которые мы видим в выпускаемых системах.

| Модальность | Что фиксирует | Типичный бенчмарк | Реальность в проде | Хорошо подходит для |

|---|---|---|---|---|

| Лицо (FER) | Микро- и макровыражения, взгляд, поза головы | 82–99% на AffectNet, CK+, RAF-DB | 60–80% «в полях», ошибка >70% при окклюзии и смене освещения | Видеозвонки, маркет-рисёрч, мониторинг водителя |

| Речь (SER) | Просодия, высота, энергия, темп речи, качество голоса | 84–97% на RAVDESS, EmoDB, IEMOCAP | 65–80%, чувствительно к акценту и языку | Колл-центры, IVR, аудиотелемедицина |

| Тональность текста | Смысл, валентность, тема, намерение | 85–93% на SST-2, MELD text | Самая стабильная между контекстами, но плохо ловит сарказм | Чаты, тикеты поддержки, разметка интервью |

| Физиология | Пульс, GSR, ЭЭГ, дыхание | 70–85% на DEAP, K-EmoCon | Нужен носимый датчик; ограничено AI Act | Клинические исследования, усталость водителя, VR UX-лаборатории |

| Мультимодальное слияние | Любая комбинация перечисленного | +3–8 п.п. поверх лучшей одиночной модальности | Самая устойчивая к шуму реального мира | Телемедицина, решения с высокой ценой ошибки |

Берите только лицо, если: у вас уже есть видеопоток, нужна задержка <200 мс и согласие пользователя получено явно (например, в платном телемедицинском визите).

Берите только речь, если: вы в колл-центре, клиенты не включают камеру или сам телефонный канал — это и есть продукт.

Берите мультимодальный подход, если: цена ложного срабатывания высока (клиническая разметка, коучинг, безопасность), а среда — неконтролируемая.

Стратегии мультимодального слияния — без жаргона

Раннее слияние конкатенирует сырые или промежуточные признаки от каждой модальности и обучает один большой классификатор. Плюсы: модель учит кросс-модальные взаимодействия end-to-end, обычно лучшие цифры на бенчмарках. Минусы: пропавшая модальность отравляет инференс, обучение хрупкое, задержка определяется самой медленной веткой.

Позднее слияние обучает отдельный классификатор на каждую модальность и затем объединяет их выходы (взвешенное усреднение, голосование или маленький MLP-gate). Плюсы: деградирует мягко, если одна модальность пропала; легко A/B-тестировать новую модальность; единственный реалистичный вариант для гибридов edge-плюс-облако. Минусы: оставляет точность «на столе» в чистых лабораторных условиях.

Гибридное (трансформерное) слияние использует cross-attention между энкодерами модальностей: текстовый декодер обращает внимание на аудиотокены, аудио — на токены лица, и так далее. Это SOTA 2025–2026 на датасетах CMU-MOSEI и MELD. Прирост точности 3–8 пунктов поверх одиночной модальности — норма; инженерная и инференс-цена крутая.

Начинайте с позднего слияния. Выпустите по классификатору на каждую модальность, объедините на уровне API и переходите к гибриду только если A/B-тест покажет, что вы реально теряете деньги.

Бенчмарк против реальности — неудобный разрыв

Вендоры обещают точность за 90%. Литература согласна — на курируемых бенчмарках. Свежие peer-reviewed FER-модели достигают 99,26% на CK+ и 82% на RAF-DB; SER-ансамбли превышают 95% на RAVDESS и 96% на IEMOCAP. Это верхняя граница.

Опубликованные in-the-wild оценки показывают рост ошибки более чем на 70% при искажениях, окклюзии, смене освещения или сдвиге распределения. На действительно невиданных пользователях и средах точность в продакшене падает в диапазон 60–80% и для лица, и для речи; сложные или социальные эмоции (смущение, презрение, сарказм) опускаются ниже 75% независимо от размера модели.

Что это значит для продуктовых решений: никогда не обещайте категорические метки эмоций. Выдавайте вероятности с откалиброванной уверенностью, выносите пороги как настраиваемые параметры и относитесь к выходу как к одному сигналу среди многих. Мы строим клиентские дашборды, в которых уверенность эмоции комбинируется с длиной сессии, очерёдностью реплик и темой — решение принимается по агрегированной метрике.

Бенчмарк показывает 90%, а в проде получается 65%?

Наша команда уже вытаскивала забуксовавшие emotion-AI-проекты — аудитом датасета, переразметкой и переобучением на гибридном слиянии. Расскажем, как помочь и вашему.

Датасеты, которые нужно знать перед обучением

Если вы строите — датасет и есть ваша фича. Если покупаете — датасет это смещение, которое вы наследуете. Каждый API-вендор обучен на каком-то подмножестве этих корпусов, и его режимы отказа отражают этот факт.

Лицо

AffectNet — более миллиона спонтанных интернет-изображений, размеченных под 8 дискретных эмоций плюс валентность и возбуждение. Рабочая лошадка индустрии — и со смещением в сторону Запада. FER-2013, 35 тыс. изображений, шумная разметка, всё ещё канонический бейзлайн. CK+ и JAFFE — постановочные лабораторные кадры, завышают метрики. RAF-DB — реальный мир. AFEW вытягивает выражения из фильмов. Aff-Wild2 — самый сильный in-the-wild корпус для непрерывной валентности и возбуждения.

Речь

IEMOCAP — 12 часов, 10 дикторов, по сценарию и импровизированно, бенчмарк для SER. RAVDESS — постановочный, сбалансирован по полу, широко используется. EmoDB (немецкий), CREMA-D (этнически сбалансированный), MELD (разговорный с ТВ). Все с перекосом в английский или немецкий.

Мультимодальные

CMU-MOSEI и MELD объединяют лицо, аудио и транскрипт — основной выбор для исследований по слиянию. DEAP и K-EmoCon добавляют физиологические каналы.

Строить или купить — матрица решений

Команды почти всегда недооценивают операционную стоимость владения моделью и переоценивают цену переключения, если стартовать с API. Ниже — общая канва, по которой мы проводим покупателей.

| Критерий | Купить (API/SDK) | Построить (custom) |

|---|---|---|

| Срок до первого пилота | 2–4 недели | 3–6 месяцев с Agent Engineering |

| Стартовая стоимость | Низкая (интеграция + UX) | Средняя (данные, разметка, инфра) |

| Потолок точности | Сколько даст вендор | Выше — на вашей конкретной аудитории |

| Контроль смещения | Чёрный ящик, аудит редко возможен | Аудит у вас в руках |

| Резиденция данных | Регион вендора или on-device SDK | Где хотите хостить |

| Операционные расходы | Поминутная или поразовая тарификация, растёт вместе с объёмом | GPU-инфра, MLOps, циклы переобучения |

| Когда выигрывает | Скорость, не-ключевая фича, стандартная вертикаль | Конкурентное преимущество, нестандартная аудитория, edge и задержки, регуляторика |

Берите гибридную сборку, если: готовая модель даёт вам 80% на вашей аудитории, а внутренний дообученный финальный слой плюс ваша собственная логика слияния закрывают разрыв — это, как правило, оптимальная точка.

Ландшафт API и SDK

Рынок консолидировался вокруг небольшого числа универсальных облачных API, специализированных рисёрч-вендоров по голосу и лицу, браузерных SDK для on-device-сценариев и вертикальных игроков (автопром, контакт-центры). Таблица ниже — текущее состояние для покупательского скоупинга. Цены индикативные и меняются ежеквартально, всегда уточняйте у вендора.

| Вендор | Модальность | Развёртывание | Цена (ориентировочно) | Подходит для |

|---|---|---|---|---|

| AWS Rekognition | Эмоции по лицу | Облако | ~0,07 ₽ за изображение, 7,5 ₽/мин видео | Быстрые пилоты по лицу внутри AWS-инфраструктуры |

| Google Video Intelligence | Лицо, детекция кадров | Облако | Поминутно, объёмные скидки | Массовая разметка видео, пользователи GCP |

| Azure Face + Video Indexer | Лицо + речь + тональность | Облако | За вызов / за минуту | Корпоративные Azure-стеки; учтите вывод из эксплуатации general-emotion API |

| Hume AI | Голос + просодия лица | Облако, стриминг по WebSocket | Поминутно, есть исследовательский тариф | Мультимодальный анализ research-уровня, выразительные голосовые UI |

| Affectiva / Smart Eye | Лицо, мониторинг салона | Встраиваемое решение / OEM | По лицензии, индивидуально | Автомобильный мониторинг водителя |

| MorphCast | Лицо | Браузерный JS SDK, on-device | Подписка, SDK <1 МБ | Маркет-рисёрч, e-learning, приватные сценарии |

| Realeyes | Лицо + внимание | Облако / SDK | Корпоративные лицензии | Тестирование рекламы, медиа-панели |

| Noldus FaceReader | Лицо, Action Units | Десктоп | Годовая лицензия | Академические и поведенческие исследования |

| Symbl.ai / Deepgram / AssemblyAI | Тональность речи, транскрипт | Облако, стриминг | Поминутный ASR + надстройка по тональности | Встречи, звонки, sales-интеллект-стеки |

Регулирование: EU AI Act изменил рынок в феврале 2025

Самый крупный регуляторный сдвиг для распознавания эмоций произошёл тихо: 2 февраля 2025 года вступила в силу статья 5(1)(f) EU AI Act, которая запрещает размещение на рынке, ввод в эксплуатацию и использование AI-систем для вывода эмоций по биометрическим данным (лицо, голос, походка, физиологические сигналы) на рабочих местах и в образовательных учреждениях. Медицинские и safety-исключения сформулированы узко. Руководящие материалы по правоприменению опубликованы 4 февраля 2025 года.

Несколько моментов, на которых спотыкаются продуктовые команды. Запрет действует независимо от страны штаб-квартиры вендора, если система предлагается людям в ЕС. Он распространяется и на голос, не только на лицо. Реклама, клиентская аналитика и не-рабочие потребительские сценарии под статью 5 не подпадают, но всё равно регулируются GDPR и правилами high-risk-классификации в других частях акта.

За пределами ЕС: GDPR по-прежнему относит вывод по биометрии к специальной категории данных по статье 9 — то есть нужно явное согласие или другое чёткое правовое основание. В США законы об обработке биометрии в стиле BIPA (Illinois) создают реальные судебные риски (Clearview и Facebook заплатили девятизначные суммы по мировым), и несколько штатов пошли следом. Великобритания и Канада в целом сходятся с GDPR. Китай регулирует распознавание лиц отдельно; индийский DPDP Act требует согласия и ограничения цели обработки.

Практическое правило: если ваш продукт — B2B для работодателей или образовательных учреждений в ЕС, не выпускайте инференс эмоций по сотрудникам или учащимся. Точка. Рассмотрите как альтернативу метрики вовлечённости и внимания (задачно-ориентированные, не аффективные).

Смещение, справедливость и что на самом деле говорит наука

Самая важная работа в этом поле — обзор Барретт, Адольфса, Марселлы, Мартинеса и Поллака 2019 года в Psychological Science in the Public Interest. Их вывод: переход от движения мышц лица к категории эмоции — связь куда более слабая, чем предполагалось в индустрии. Люди улыбаются, не будучи счастливыми; конфигурации лица варьируются по культуре, контексту и индивиду; «универсальные базовые эмоции» — спорная модель, а не устоявшаяся наука.

В переводе на продуктовые риски: готовые API эмоций, обученные на западных, более молодых и мужчиноцентричных датасетах, ошибаются на темнокожих женщинах, носителях восточно-азиатских языков, пожилых пользователях и вообще на тех, чей выразительный идиом отличается от обучающего распределения — измеримо и воспроизводимо. Задокументированные аудиты показывают разрыв в точности 5–20 пунктов между демографическими группами на одном и том же бенчмарке. Просите у вендоров отчёты по точности в разрезе демографии — большинство их не отдадут.

Меры, которые реально работают: сбалансированные обучающие данные (CREMA-D, CAER-S для лица, подмножество MELD для текста), постфактум-калибровочный слой на каждый демографический сегмент, список «не выводить эмоции для…» (найм, оценка эффективности, поведенческая медицина без участия клинициста) и непрерывный мониторинг дрейфа. Бесплатного тут ничего нет. Зато всё это дешевле, чем коллективный иск.

Эталонная архитектура продакшен-системы

Рисунок 2 показывает архитектуру, с которой мы начинаем работу над мультимодальными emotion-aware продуктами. Мы сознательно выносим лёгкий инференс по лицу на edge и обращаемся в облако за более тяжёлыми моделями речи и текста — это правильный компромисс для телемедицины, контакт-центров и sales-интеллект-нагрузок.

Рисунок 2. Эталонная продакшен-архитектура мультимодального распознавания эмоций.

Неочевидные части: слой согласия и аудита, проставляемый на каждый инференс (состояние opt-in пользователя, юрисдикция, feature flag), feature store с TTL 30 дней, чтобы переобучение не требовало нового извлечения данных, и канал обратной связи, в котором операторы помечают ложные срабатывания — без этого цикла модели тихо деградируют месяцами.

Мини-кейс: чему нас научил запуск распознавания эмоций в продажах по видеосвязи

Ситуация. Скандинавская B2B-платформа sales-интеллекта хотела live-сигналы вовлечённости во время звонков в Zoom, Teams и Google Meet — не размеченные эмоции, а измеримые поведенческие подсказки (внимание, согласие, замешательство), которые можно вернуть менеджеру прямо во время разговора.

12-недельный план. Недели 1–2: поток согласий, мост кросс-платформенного захвата. Недели 3–6: пайплайн просодии речи на Whisper + лёгкая SER-голова, плюс анализ вовлечённости по лицу (взгляд, улыбка, брови) через WASM-модель на устройстве. Недели 7–9: позднее слияние в общий engagement-скор, подбор порогов на реальных клиентских звонках. Недели 10–12: UX-коучинг менеджера в звонке, постзвоночное саммари, выгрузка в CRM.

Результат. 25% рост конверсии в сделку по сравнению с подобранным базовым периодом до запуска; 80–100% полей CRM автозаполняются на основе метаданных звонка и эмоционально-смежных сигналов; качественная обратная связь, что менеджеры стали больше доверять engagement-скору, когда мы перестали подписывать его как «счастливый / грустный» и начали — как «внимательный» и «возражающий». Продукт работает как Meetric. Если вам нужна похожая оценка вашего стека — звоните или пишите.

Модель стоимости — как выглядит реальный проект

Цифры ниже исходят из нашей доставки, ускоренной Agent Engineering: наши AI-сборки идут быстрее и легче, чем классическая аутсорсинговая модель. Это диапазоны, а не коммерческое предложение; реальные суммы зависят от вашего стека, доступа к данным и периметра комплаенса.

| Объём работ | Типичная длительность | Стоимость сборки | Операционные расходы |

|---|---|---|---|

| Интеграция API (лицо или речь) | 3–6 недель | 1,5–4,5 млн ₽ | Платежи вендору API, растут с объёмом |

| Мультимодальный MVP на вашем видеостеке | 8–14 недель | 4,5–12 млн ₽ | Смешанная плата за API + умеренная GPU-инфра |

| Custom-модель со слиянием и дообучением | 4–8 месяцев | 11–33 млн ₽ | GPU-кластер, MLOps, абонемент на разметку |

| Регулируемый клинический деплой (близкий к SaMD) | 6–12 месяцев | 22–67 млн ₽ | Аудит, ревалидация, клинические операции |

Наш опыт: лучший ROI большинство покупателей получают от первых двух строк, а дообучение поверх — добавляют только когда есть реальные продакшен-данные и конкретный режим отказа, который нужно закрыть.

Фреймворк решений — выбор пути за пять вопросов

1. Кто субъект? Клиенты, пациенты, учащиеся, сотрудники, водители или широкая публика? Если «сотрудники или учащиеся» в ЕС — остановитесь и пересмотрите объём: действует статья 5.

2. Какое решение управляется сигналом? Подсказка пользователю, решение о пользователе или что-то посередине? Решения о человеке (найм, кредит, клиническая сортировка) резко поднимают регуляторную и этическую планку; подсказки и коучинг — куда менее рискованны.

3. Какая модальность у вас уже есть? Если у вас есть видеопоток (телемедицина, sales-звонок), связка «лицо + голос» — дёшево; если есть только телефонный номер, скорее всего, правильный объём — SER.

4. Насколько необычна ваша аудитория? Дети, пожилые, лица в масках, неносители языка, акцентная речь? Чем более нестандартна аудитория — тем больше нужен собственный пайплайн данных и тем меньше можно доверять заявлениям точности готовых решений.

5. Какова ваша терпимость к ложным срабатываниям? Они есть у любой emotion-системы. Если ложная пометка «в дистрессе» клиницисту допустима — продолжайте; если та же пометка триггерит автоматическое действие с последствиями, не выпускайте без человека в петле.

Ошибки, которые мы продолжаем видеть

1. Категорические метки в UI. «Пользователь зол» — это худший UX, чем «тон звонка повышается, менеджеру стоит сбавить темп». Показывайте откалиброванную уверенность и поведенческие сигналы, а не дискретные категории эмоций.

2. Пропуск слоя согласия. GDPR (статья 9) и AI Act требуют per-user opt-in на биометрический вывод — и пользователи отзывают согласие. Если ваша система не может отключить инференс по одному пользователю без релиза — это комплаенс-проблема.

3. Восприятие демографического разрыва как ошибки округления. Падение точности на 15 пунктов на одной этнической группе — не шум, а судебный иск. Аудитируйте ежеквартально, ребалансируйте обучающие данные, выпускайте внутренние accuracy cards.

4. Игнорирование временного контекста. Классификация по одному кадру или одной реплике нестабильна. Сглаживайте в окне 3–10 секунд, давайте больший вес свежим кадрам, требуйте устойчивости сигнала, чтобы он сработал.

5. Недостаточное инструментирование. Emotion AI дрейфует. Если вы не логируете предсказания, эталон (когда его можно собрать) и обратную связь пользователя — заметите проблему только когда заметит регулятор или клиент.

KPI: что измерять

KPI качества. Per-class precision и recall на отложенной продакшен-выборке (цель — F1 ≥ 0,75 для основного класса). Демографическая парность: абсолютный разрыв точности ≤ 5 пунктов по расе, полу и возрастным группам. Ошибка калибровки (ECE) ≤ 0,05.

KPI бизнеса. Attach rate фичи, доля действий на инференс (кто-то вообще пользуется подсказкой?), прирост конверсии или улучшение исхода в контролируемом раскате, доля opt-in (здоровый поток согласия даёт 40–70%).

KPI надёжности. P95-задержка инференса (цель — <250 мс для real-time UX), алёрты дрейфа модели (еженедельные проверки распределения), частота инцидентов с ложными эскалациями и время отката версии модели.

Когда НЕ использовать распознавание эмоций

Не выпускайте фичу, если выполняется хоть одно из следующего. (а) Ваш кейс — сотрудники или учащиеся в ЕС, а вы не попадаете под медицинское или safety-исключение. (б) Сигнал должен принимать решение о человеке без участия человека в петле. (в) Нет пути собрать демографически сбалансированные данные для оценки — вы выпустите смещённый инференс и не узнаете об этом. (г) Продукт уже работает; распознавание эмоций прикручивается, потому что это модно. Стоп.

В большинстве этих случаев лучше выбрать поведенческую метрику — соотношение talk time, детекция тишины, латентность ответа, извлечение ключевых слов. Это дешевле, стабильнее и значительно меньше регулируется.

Готовы оценить распознавание эмоций или сигналы вовлечённости для вашего продукта?

Проведём аудит вашего видео- и аудиостека, подскажем правильную модальность, оценим сборку с Agent Engineering и вернёмся с one-pager, который можно показать совету директоров.

FAQ

Насколько точно распознавание эмоций в аудио и видео работает на практике?

На курируемых бенчмарках современные модели по лицу достигают 82–99%, по речи — 84–97%. В продакшене ожидайте 60–80% для одиночной модальности и следите за обрывами точности более 70 пунктов при смене освещения, окклюзии, акцентах или демографическом сдвиге. Мультимодальное слияние обычно добавляет 3–8 пунктов к самой сильной одиночной модальности.

Законно ли распознавание эмоций в ЕС?

Со 2 февраля 2025 года AI-системы, выводящие эмоции по биометрическим данным на рабочих местах и в образовательных учреждениях, запрещены по статье 5(1)(f) EU AI Act. Медицинские и safety-исключения сформулированы узко. Клиентские и потребительские контексты под статью 5 не подпадают, но остаются под GDPR и другими обязательствами AI Act.

Строить свою модель или использовать API?

Начинайте с API или SDK. Стройте или дообучайте, только если готовая производительность на вашей аудитории явно недостаточна, у вас есть дифференцирующие обучающие данные или требования по резиденции данных и задержке исключают сторонние эндпойнты. Большинство развёртываний у нас стартуют как интеграция API и переходят в гибрид (дообученная голова + собственное слияние) только после замеров реального бейзлайна.

Сколько стоит добавить распознавание эмоций в видеопродукт?

Интеграция API для одной модальности обычно — 1,5–4,5 млн ₽ и 3–6 недель. Мультимодальный MVP на существующем видеостеке — обычно 4,5–12 млн ₽ за 8–14 недель. Custom-модель со слиянием и дообучением — 11–33 млн ₽ за 4–8 месяцев. Диапазоны предполагают нашу доставку, ускоренную Agent Engineering.

На каких датасетах обучать?

Для лица: AffectNet и RAF-DB как рабочие лошадки, Aff-Wild2 для непрерывной валентности/возбуждения в реальных условиях, CREMA-D — для демографически более сбалансированной аудио-видео-разметки. Для речи: IEMOCAP и RAVDESS для бенчмаркинга, MELD — для разговорного. Для мультимодального слияния: CMU-MOSEI и MELD. Смешивайте с собственными размеченными продакшен-данными — ни один публичный набор не репрезентативен глобально.

Как работать со смещением и справедливостью?

Запрашивайте у вендоров разбивку точности по демографии; настаивайте на сбалансированном обучении или постфактум-калибровке per-segment; аудитируйте ежеквартально на реальных продакшен-данных; ограничивайте абсолютный разрыв точности по расе, полу и возрасту 5 пунктами; выпускайте внутренние accuracy cards. Готовьтесь переразмечать и переобучать минимум раз в год.

Можно ли запускать распознавание эмоций на устройстве ради приватности?

Да, всё больше. Браузерные SDK вроде MorphCast запускают анализ лица полностью в браузере (WASM/WebGL) с моделью меньше 1 МБ, не отправляя биометрию на сервер. Мобильные фреймворки (Core ML, TensorFlow Lite, ONNX) позволяют выпустить квантизованную модель лица или речи прямо на устройстве. Точность на 5–10 пунктов ниже облачных моделей, но выигрыш в приватности и задержке обычно это оправдывает.

Сколько занимает реальное внедрение?

API-пилот — 2–4 недели; продакшен-готовая мультимодальная фича со слоем согласия, мониторингом и калибровкой — 10–16 недель; регулируемый клинический или safety-деплой — 6–12 месяцев, включая аудиты и ревалидацию. Agent Engineering ощутимо сжимает каждый из этих этапов по сравнению с классическим аутсорсингом.

Что почитать дальше

Распознавание эмоций в реальном времени

Real-Time AI Emotion Software

Подробнее о live-сигналах аффекта в видеозвонках и контакт-центрах.

Эмоции в речи

Audio Emotion Detection System Using AI

Как SER-пайплайны строятся end-to-end и какие признаки выбирают.

Эмоции по лицу

Machine Learning for Video Emotion Analysis

Сфокусированный обзор лицевой части пайплайна: модели, датасеты, развёртывание.

Видеоконференции

AI Emotion Detection in Video Conferences

Продуктовые шаблоны для интеграции аффект-сигналов в Zoom, Teams и Meet.

Услуги

Услуги Фора Софт по AI-интеграции

Наш стек, кейсы и быстрый путь к оценке AI-проекта вместе с нами.

Готовы запустить распознавание эмоций, которое держит удар в продакшене?

Короткий ответ на «стоит ли добавлять распознавание эмоций в аудио и видео?» — только если сигнал делает решение дешевле, безопаснее или лучше, и только после того, как вы определились с модальностью, вендором или моделью и применимым комплаенс-режимом. Режимы отказа предсказуемы — переоценка по бенчмаркам, демографическое смещение, пробелы в согласиях, мёртвые метки вместо живых сигналов — и каждый из них чинится инженерией, а не уклонением.

Фора Софт выпускала emotion-смежные AI в sales-видео, видеомаркет-рисёрче, телемед-смежных платформах и поведенческом видеонаблюдении. Мы знаем, где обрывы, что именно Agent Engineering даёт по срокам, и скажем вам прямо, когда правильный ответ — «не строить эту фичу». Если вам нужен такой разговор — звоните или пишите.

Получите второе мнение по распознаванию эмоций в аудио и видео

Кратко обсудим задачу, дадим чёткий объём и диапазон стоимости и честный совет — строить, покупать или отложить фичу.