Главное

• Edge выигрывает по задержке на порядок. Edge AI инференс для видеонаблюдения укладывается в 20–100 мс; полный круг до облака и обратно занимает 300–800 мс. Для алертов в реальном времени это разница между вмешательством и разбором постфактум.

• Cloud-only egress тихо разоряет вас уже на 20+ камерах. Развертывание из 100 камер 1080p, стримящих в облако, сжигает около 5,7 млн ₽ в год только на egress AWS. Edge-инференс с выборочной загрузкой снижает это примерно до 112 тыс. ₽.

• EU AI Act, действующий с августа 2026, делает edge-обработку безопасным выбором по умолчанию. Удаленная биометрическая идентификация по видеонаблюдению теперь отнесена к высокорисковым; хранение исходного видео на устройстве сужает зону комплаенса для GDPR, HIPAA, BIPA и CCPA.

• Гибрид — продакшен-паттерн 2026 года. Verkada, Rhombus, Avigilon Unity и Axis ACAP делают edge-инференс плюс облачную оркестрацию плюс асинхронное переобучение. Чисто облачное видеонаблюдение сжимается; AWS Panorama закрывается 31 мая 2026 года.

• Правильный ответ зависит от пяти вопросов. Количество камер, бюджет задержки, регуляторная экспозиция, надежность сети и частота обновления модели определяют, идти ли вам в edge-primary, cloud-primary или гибрид — и ниже мы разбираем каждый.

Почему этот выбор важен именно в 2026

В этом году совпали три фактора, которые заставили каждого CTO в видеонаблюдении пересмотреть архитектуру: 2 августа вступила в силу классификация удаленной биометрической идентификации как высокорисковой по EU AI Act; AWS объявил о закрытии Panorama 31 мая 2026 года; цена на мощные edge-ускорители опустилась настолько, что модуль Hailo-8 стоит дешевле одного месяца облачного GPU-инференса.

Итог: каждый новый проект видеонаблюдения вынужден обосновывать размещение вычислений по существу. «Шлем все в облако» больше не работает как аргумент перед юристами, финансистами и операционным блоком. В этой статье мы даем цифры, компромиссы и фреймворк из пяти вопросов, чтобы принять это решение — ориентируясь на команды, проектирующие кастомный продукт AI-видеонаблюдения, а не розничный ретейл с 5 камерами.

Почему этот гайд написала Фора Софт

Фора Софт (Fora Soft) делает видео- и AI-продукты с 2005 года. За 600+ выпущенных проектов наша работа сосредоточена вокруг трех вещей: видеопайплайны реального времени, детекция и трекинг компьютерного зрения, надежность уровня видеонаблюдения. Мы используем spec-driven agent engineering, чтобы сжимать то, что раньше было полугодовой разработкой, в 8–12 недель — и это отражается на цене.

Несколько проектов задают тон этому гайду. V.A.L.T. — платформа видеодоказательств, которой пользуются 650+ организаций в США (полиция, центры защиты детей, медицина): 2 500 IP-камер, 25 000 пользователей в день, 727 млн ₽ выручки. DSI Drones — система воздушного видеонаблюдения, стримящая видео по радиоканалу с детекцией транспорта и людей прямо на устройстве. Netcam Studio — веб-интерфейс видеонаблюдения, построенный на YOLOv8/YOLOv9 + DeepSORT. Каждое архитектурное решение из этой статьи мы хотя бы один раз приняли в продакшене.

Не можете выбрать edge или cloud для своего проекта видеонаблюдения?

Расскажите количество камер, целевую задержку и требования по комплаенсу. Мы накидаем гибридную архитектуру и бюджет — позвоните или напишите.

Edge AI или Cloud AI: ответ за 60 секунд

Edge AI запускает детекцию и трекинг на самой камере или рядом с ней — на смарт-сенсоре, встраиваемом SoC вроде Hailo-8 или небольшом NVIDIA Jetson. Кадры не покидают здание, пока не сработает алерт. Cloud AI отправляет каждый кадр (или каждый ключевой кадр) по сети на удаленный GPU, выполняет инференс там и возвращает результат. Гибрид делает edge-инференс для детекции в реальном времени, а потом перенаправляет тонкий слой данных — клипы по алертам, эмбеддинги или редкие снимки — в облако для долгосрочной аналитики, переобучения и анализа по всему парку.

Если хотите ответ одним предложением: edge для алерта, облако для инсайта, тонкий канал между ними. Остальная часть статьи — математика этой рекомендации.

Задержка: десятки мс против сотен мс

Задержка — самое простое сравнение и самое критичное для видеонаблюдения. От нее зависит, успеет ли охранник, турникет или автоматический алерт вмешаться до того, как человек пройдет контрольную точку. Мы измеряем четыре участка пайплайна.

| Участок пайплайна | Edge AI (типичная) | Cloud AI (типичная) | Комментарий |

|---|---|---|---|

| Захват и кодирование | 15–33 мс | 15–33 мс | Идентично — одинаковый аппаратный путь. |

| Загрузка по сети | 0 мс | 40–200 мс | RTT до ближайшего региона облака; джиттер на сотовой связи. |

| Инференс | 8–30 мс (YOLOv8n INT8 на Orin Nano) | 10–25 мс (YOLOv8m FP16 на T4) | Облако использует более крупную модель, edge — квантованную меньшую. |

| Доставка результата | 2–10 мс (LAN-вебхук) | 40–200 мс (обратный RTT) | Еще один сетевой хоп на обратном пути. |

| Сквозная | 25–100 мс | 300–800 мс | Облако через сотовую связь регулярно превышает 1,2 с. |

Для предотвращения краж в рознице, охраны периметра, отбраковки на производстве и алертов о безопасности детей вы не можете позволить себе 800 мс. За это окно человек делает один шаг. Для трендовой аналитики — тепловых карт посещаемости, времени пребывания, длины очереди за смену — задержка облака не важна; вопрос в пропускной способности и стоимости, а не в миллисекундах.

Берите edge-инференс, когда: алерт должен сработать менее чем за 200 мс, камера на сотовой связи или нестабильном Wi-Fi, либо сценарий критичен по безопасности (вторжение, обнаружение падения, остановка линии).

Структура расходов: edge-железо против облачного egress и SaaS

В любом бюджете на видеонаблюдение появляются три отдельные статьи расходов. Их надо читать как конкурирующие, а не взаимозаменяемые: расходы на edge — это CapEx, расходы на облако — OpEx, который растет вместе с числом камер и часами работы.

Стоимость edge-железа на камеру (прайс-лист 2026)

NVIDIA Jetson Orin Nano Super стоит 18 600 ₽ при 67 TOPS на 7–15 Вт. Модули Hailo-8 идут по 11 200–15 000 ₽ при 26 TOPS на 2,5 Вт — лучший показатель TOPS на ватт в категории. Google Coral USB и Coral M.2 идут от 3 700 до 7 500 ₽ для более легких задач. Смарт-камеры со встроенным AI (Hanwha Wisenet 9, Axis с ACAP-аналитикой) поставляются по 22 500–60 000 ₽ за камеру с уже встроенным кремнием для инференса.

Облачный GPU-инференс

Постоянно работающий инстанс AWS p3.2xlarge (NVIDIA V100) стоит около 229 ₽/час по тарифу on-demand — примерно 1,6 млн ₽ в месяц за GPU. Один GPU спокойно обслуживает 25–40 потоков 1080p·30fps на YOLOv8m, в зависимости от размера батча и постобработки. Распределите эту стоимость GPU по потокам — и получите около 41 000 ₽ на камеру в месяц только за облачный инференс, без хранения и трафика.

Подписки на закрытые облачные SaaS

Verkada берет 22 500–37 500 ₽ за камеру в год (нужно собственное проприетарное железо). Eagle Eye Networks — 375–2 250 ₽ за камеру в месяц на открытых ONVIF-камерах. AWS Panorama (до закрытия 31 мая 2026) брал 624 ₽ за камеру в месяц. Подписки запускаются проще всего и быстрее всего привязывают к вендору.

| Архитектура | 1-й год / 100 камер | 3-й год / 100 камер | Привязка к вендору |

|---|---|---|---|

| Edge DIY (Jetson + open-source модели) | ~3,3 млн ₽ железо + интеграция | ~4,5 млн ₽ | Низкая |

| Смарт-камеры (Hanwha / Axis ACAP) | ~4,5 млн ₽ железо + легкая интеграция | ~5,2 млн ₽ | Средняя (вендорский SDK) |

| Cloud SaaS (класса Verkada) | ~7,1 млн ₽ железо + ~3 млн ₽ подписка | ~16 млн ₽ | Высокая (проприетарные камеры) |

| Cloud-only инференс (DIY GPU) | ~2,2 млн ₽ камеры + ~6 млн ₽ egress + ~19 млн ₽ GPU | ~78 млн ₽ | К облачному вендору |

| Гибрид (edge-инференс + облачная оркестрация) | ~4,1 млн ₽ железо + ~150 тыс. ₽ облако | ~5,2 млн ₽ | Низкая–средняя |

Читайте таблицу справа налево. К третьему году гибрид примерно в 15× дешевле чисто облачного инференса и окупает первоначальные вложения в edge меньше чем за 12 месяцев на любом проекте от 20 камер с непрерывными потоками.

Берите cloud-only, когда: у вас меньше 10 камер, вам действительно не нужны алерты в реальном времени и вас устроит SaaS-подписка, цена которой может удвоиться при продлении.

Математика трафика: где cloud-only тихо ест бюджет

Поток H.264 1080p·30fps в среднем дает около 4 Мбит/с. Умножьте на количество камер, часы и 30 дней — и счет за egress становится самой крупной строкой расходов в cloud-first архитектуре, опережая GPU и хранилище.

| Сценарий | Совокупный аплинк | Egress в год (AWS 6 ₽/ГБ) |

|---|---|---|

| 10 камер, полная загрузка, 24/7 | 40 Мбит/с | ~1 млн ₽ |

| 100 камер, полная загрузка, 24/7 | 400 Мбит/с | ~10 млн ₽ |

| 100 камер, edge отсекает 90% кадров | 40 Мбит/с в среднем | ~1 млн ₽ |

| 100 камер, edge-инференс + только клипы алертов | ~4 Мбит/с в среднем | ~105 тыс. ₽ |

Два неочевидных момента. Во-первых, цены AWS на egress снижаются с ростом объема, а вход в облако бесплатный — убивает вас именно вытаскивание результатов, дашбордов и экспортов клипов наружу. Во-вторых, аплинк провайдера упирается в потолок раньше, чем стоимость egress. Постоянная загрузка 400 Мбит/с с одной розничной точки требует бизнес-канала с симметричной полосой; в большинстве магазинов аплинк всего 50 Мбит/с. Edge-инференс снимает это физическое ограничение.

Точность: чего на самом деле стоит INT8-квантование

Справедливая претензия к edge AI — что вы запускаете меньшую квантованную модель. Справедливый ответ — что разрыв уже намного меньше, чем три года назад. Современное post-training INT8-квантование с правильной калибровкой теряет 5–8% mAP на YOLOv8s и дает на 30–50% более быстрый инференс. Quantization-aware training сводит большую часть этого к менее 3%. Для типичных классов видеонаблюдения — человек, машина, посылка, оружие, огонь — практическая частота детекции неотличима.

Реальное преимущество облака по точности не в чистой детекции объектов. Оно в рассуждении: сопоставлении данных с 50 камер для отслеживания нужного человека, применении vision-language model для описания нестандартной сцены, подаче мультимодального контекста в классификатор поведения. Edge-устройство не вместит 7B-параметрическую VLM в 8 ГБ единой памяти. Это и есть аргумент в пользу гибрида: детектируем на edge, рассуждаем в облаке.

Практический рецепт edge-модели

1. Возьмите наименьшую модель, которая берет ваш порог mAP. YOLOv8n или YOLOv8s для большинства задач видеонаблюдения; YOLOv8m оставьте для криминалистического поиска в облаке.

2. Квантуйте на калибровочных данных с ваших реальных камер. Выборка из 500–1000 кадров с днем, ночью, разной погодой и плотностью толпы убирает большую часть потери точности.

3. Сочетайте детекцию с ByteTrack или BoT-SORT. Трекеры снижают ложные срабатывания за счет временной согласованности — ошибка в одном кадре не запускает алерт. Наш подробный гайд разбирает это от начала до конца: Build Custom AI Video Surveillance with YOLO, ByteTrack, BoT-SORT & DeepSORT.

4. Сложные случаи отправляйте в облако. Все, что ниже вашего порога уверенности, — кандидат на повторный инференс более крупной моделью и на добавление в выборку для переобучения.

Берите облачное рассуждение, когда: нужно сопоставлять детекции между камерами, запускать vision-language model для описания сцены или применять кастомный поведенческий классификатор, слишком тяжелый для встраиваемого SoC.

Приватность и EU AI Act с августа 2026

С 2 августа 2026 удаленная биометрическая идентификация в режиме реального времени по видеонаблюдению относится к высокорисковым по EU AI Act. Это не запрет, но обязательства тяжелые: оценка соответствия, оценка влияния на основные права, ведение журналов, человеческий надзор. Биометрический скрапинг с записей видеонаблюдения прямо запрещен, как и распознавание эмоций на работе и в образовании. Финансовая экспозиция за нарушение доходит до 35 млн евро или 7% мирового оборота.

Edge-обработка — самая чистая позиция по комплаенсу по трем причинам. Во-первых, исходное видео не покидает здание, что снимает вопросы трансграничной передачи данных по главе V GDPR. Во-вторых, можно обезличивать на этапе захвата — размывать лица, скрывать номера — до того, как данные сохранятся, что выполняет принцип минимизации данных (статья 5). В-третьих, вы держите четкую границу контролера данных; ни в AWS, ни в Azure, ни в GCP никто не получает доступа к биометрическим данным ваших субъектов.

Та же логика применима в других юрисдикциях. BIPA в Иллинойсе требует явного согласия на сбор биометрии — edge-обработка без хранения позволяет вообще не активировать это требование. HIPAA покрывает записи с пациентов в медицине США; держать эти записи во внутренней сети больницы намного проще обосновать, чем отправлять в стороннее облако. NDAA Section 889 запрещает федеральным агентствам США использовать оборудование видеонаблюдения с зарубежной облачной зависимостью. Тему доверия и этики мы подробнее разбираем в смежной статье 2026 AI Surveillance Trends and Ethics.

Берите edge-обезличивание, когда: ваш продукт затрагивает резидентов ЕС, больницы, школы, государственные здания или любые категории субъектов, где согласие в массе невозможно.

Надежность и работа без сети

Cloud-only видеонаблюдение жестко зависит от интернет-канала. Когда провайдер падает, камеры превращаются в немые источники пикселей. Edge AI продолжает детектировать, поднимать алерты через локальные сирены, IO-реле или LAN-вебхуки, и буферизовать события до возврата связи. На наших развертываниях V.A.L.T., обслуживающих цепочку доказательств для полиции, такая буферизация — это юридическое требование: пропавшие 30 минут записи во время сетевого сбоя ломают цепочку хранения улик.

Архитектуры, сочетающие edge-буферизацию с облачной синхронизацией, объективно надежнее, чем любой из чистых вариантов. Edge-устройства хранят 24–72 часа локально на SD или NVMe (смарт-камеры Hanwha Wisenet идут с дисками до 4 ТБ), а потом подгружают в фоне в нерабочие часы. Среднее время восстановления после сбоя сокращается до секунд вместо тех 15 минут–2 часов, которые нужны cloud-only системе на повторную синхронизацию состояния.

Нужно автономное видеонаблюдение, которым вы реально владеете?

Мы проектируем гибридные системы, в которых edge продолжает работать, когда облако недоступно — и данные остаются там, где этого требует комплаенс.

Гибридная архитектура: что реально делают продакшен-системы

Посмотрите на самых быстрорастущих вендоров видеонаблюдения 2026 — все они сходятся к одной и той же форме: edge-инференс, облачная оркестрация, асинхронное переобучение. Verkada, Rhombus, Avigilon Unity и Axis ACAP плюс кастомный бэкенд — все вписываются в этот паттерн. Тот же паттерн мы строим клиентам.

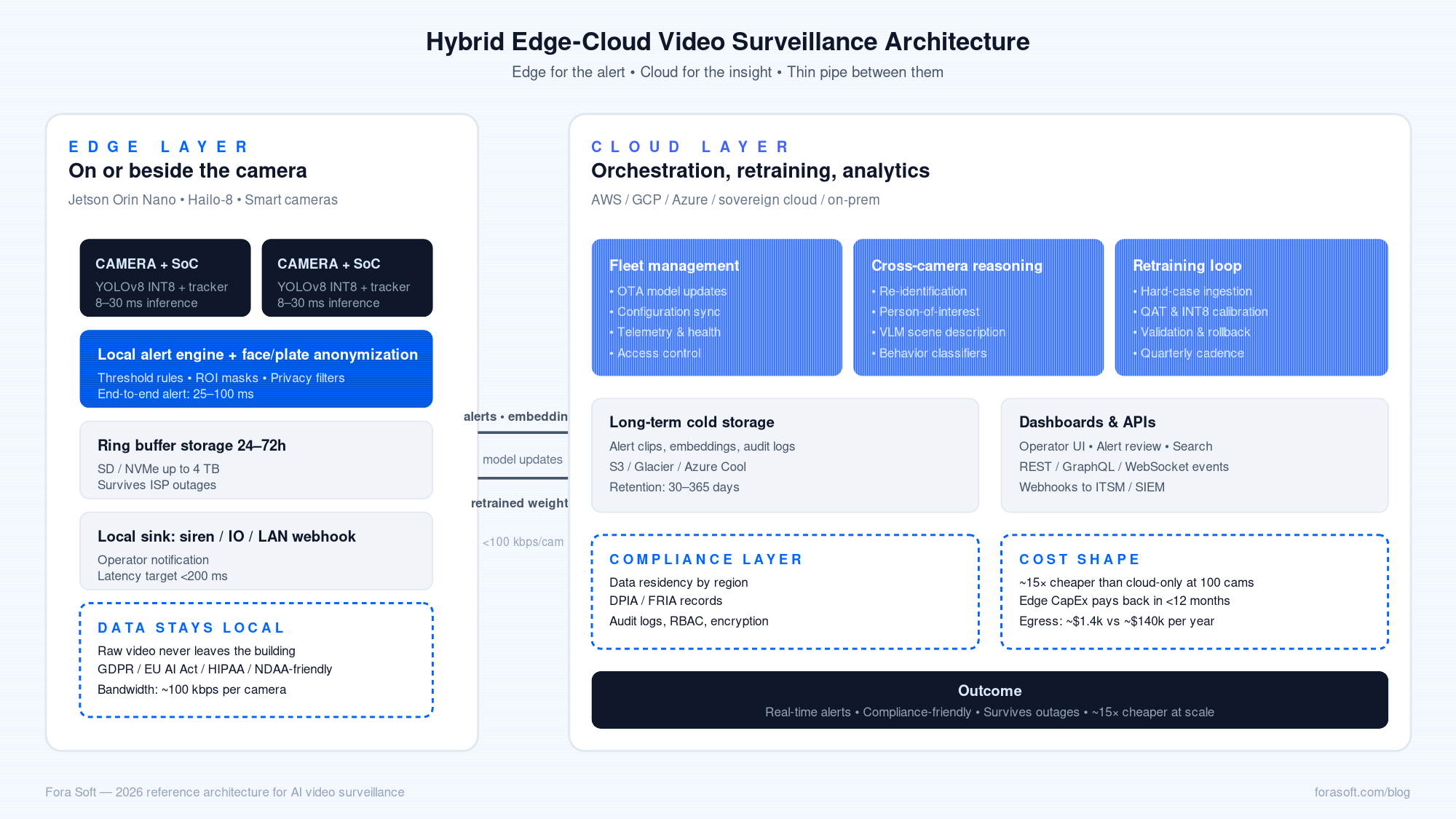

Рис. 1. Эталонная гибридная архитектура AI-видеонаблюдения 2026 года.

Что живет на edge

Детекция в реальном времени (YOLO + трекер), обезличивание лиц и номеров, правила алертов, кольцевой буфер последних 24–72 часов и watchdog, который пытается восстановить связь с облаком. Edge — единственный источник правды о том, «что только что произошло в этом кадре».

Что живет в облаке

Управление парком (конфигурация, версионирование моделей, OTA-обновления), долговременное холодное хранилище клипов алертов, межкамерный анализ (повторная идентификация, отслеживание интересующего лица по кампусу), описание сцен через VLM, дашборды и пайплайн переобучения, который забирает с edge сложные примеры.

Что течет между ними

Три тонких потока: алерты (небольшой JSON + клип), эмбеддинги (несколько КБ на детекцию для последующего поиска) и выборочные кадры со сложными случаями (с низкой частотой). Совокупный аплинк остается значительно ниже 100 кбит/с на камеру даже в часы пик. Наши материалы по интеграции видеоаналитики с системами наблюдения и по лучшим практикам real-time видеообработки разбирают детали стриминга.

Цены вендоров: Verkada, Eagle Eye, Rhombus, DIY edge

Если вы оцениваете дилемму build vs. buy, вот срез, который мы показываем клиентам. Цифры — прайс-лист, США, 2026.

| Вендор | Стоимость камеры | Регулярные платежи | Архитектура | Привязка |

|---|---|---|---|---|

| Verkada | 37 500–225 000 ₽ | 22 500–37 500 ₽/камера/год | Облачное управление, edge-обработка (проприетарно) | Высокая |

| Eagle Eye Networks | 15 000–60 000 ₽ (любая ONVIF) | 4 500–27 000 ₽/камера/год | Cloud-first VMS | Средняя |

| Rhombus Systems | 45 000–75 000 ₽ | 7 500–18 700 ₽/камера/год | Гибрид (edge + облачная оркестрация) | Средняя |

| Axis + ACAP | 22 500–60 000 ₽ | 0–37 500 ₽/объект за аналитику | Edge-расширяемая камера | Средняя |

| Hanwha Wisenet 9 | 30 000–45 000 ₽ | VMS опционально | Смарт-камера со встроенным AI | Низкая–средняя |

| DIY edge (Jetson + open-source) | 18 600 ₽ + камера | Инженерные часы | Кастомный гибрид | Минимальная |

Для большинства продуктовых команд практический выбор — это «смарт-камеры + кастомный бэкенд» или «DIY edge + кастомный бэкенд». Первый меняет инженерные часы на зрелость вендора; второй меняет зрелость вендора на полный контроль над кривой расходов и моделью. Мы делали оба.

Правила выбора по сценариям в 7 отраслях

| Отрасль | Рекомендуемое размещение | Почему |

|---|---|---|

| Розница: предотвращение потерь | Гибрид | Edge для алертов о краже; облако для корреляции по магазинам и аналитики потерь. |

| Производство | Edge-primary | Детекция дефектов и СИЗ требует <100 мс; чувствительные к IP записи остаются во внутренней сети завода. |

| Логистика и склады | Edge | Нестабильная связь; детекция паллет и SKU на воротах. |

| Умный город и трафик | Гибрид | Edge для управления светофорами; облако для городского планирования. |

| Здравоохранение и уход за пожилыми | Только edge | HIPAA + достоинство пациента; алерты о падении в отделении за <1 с. |

| Критическая инфраструктура / госорганы | Edge + on-prem | NDAA, требования к локализации данных, суверенные облака. |

| SMB / частные дома | Cloud SaaS | 5–10 камер, низкая сложность, подписка вполне подходит. |

Фреймворк принятия решения — выбираем edge, cloud или гибрид за пять вопросов

1. Сколько камер и какой битрейт? Меньше 10 камер на низком битрейте — cloud SaaS подойдет. Больше 20 при 4 Мбит/с на камеру — edge или гибрид окупится за год только за счет трафика.

2. Какой бюджет задержки на алерт? Меньше 200 мс — edge. От 200 мс до 1 с — гибрид. Несколько секунд приемлемы — облако работает.

3. Какие регуляторы вас касаются? Высокий риск по EU AI Act, GDPR, HIPAA, BIPA, NDAA — edge с обезличиванием на захвате — самый безопасный выбор по умолчанию. CCPA или общий коммерческий случай — облако работоспособно при правильном DPA.

4. Насколько надежна сеть? Промышленные объекты, транспорт, удаленные локации — edge, чтобы система пережила обрывы связи. Стабильный корпоративный Wi-Fi — облако или гибрид.

5. Как часто вы переобучаете? Раз в квартал или реже — edge с периодическими OTA-обновлениями. Раз в неделю или чаще — нужен облачный цикл переобучения, но инференс по-прежнему может идти на edge.

Если три и более ответов смотрят в сторону edge — проектируйте гибрид с edge-primary. Если три и более тянут к облаку — гибрид с cloud-primary. Чистый edge и чистое облако — крайние случаи.

Мини-кейс: V.A.L.T. — 2 500 камер, 650 организаций, 25 000 пользователей в день

Контекст. Американская платформа видеодоказательств для полиции, центров защиты детей и медицинских организаций. Системе нужно было закрывать управление PTZ, плановые и триггерные записи, push-to-talk и нерушимую цепочку хранения улик — и все это в помещениях с разным качеством сети.

Что мы сделали. Агенты-рекордеры на стороне камер, которые работают локально на каждом рабочем месте (edge-буферизованные доказательства с криптографическими хешами), плюс облачный слой оркестрации для расписаний, поиска и контроля доступа. Детекция идет на камере; корреляция, поиск и журналы аудита — в облаке. Система аккуратно переживает сбои провайдера, потому что рекордер сохраняет цепочку хранения целой.

Результат. 2 500 IP-камер под управлением, 25 000 пользователей в день, 650 организаций-клиентов, 727 млн ₽ выручки. Ноль сбоев цепочки хранения улик за сотни расследований. Если вы строите что-то похожее — позвоните или напишите нам, мы расскажем подробнее.

Пять ловушек, в которые попадают команды

1. Берут самый маленький edge-бокс с хорошими бенчмарками. В лаборатории Jetson Orin Nano выдает отличные цифры. В электрощитовой при 40 °C он начинает троттлить. Берите следующий по размеру или с первого дня закладывайте активное охлаждение и нормальные корпуса.

2. Пропускают цикл переобучения. Edge-модель, развернутая один раз и больше не обновляемая, дрейфует. Через 12–18 месяцев частота ложных срабатываний заметно растет. Спланируйте облачный сбор сложных случаев и путь OTA-обновления модели до запуска.

3. Дают камерам диктовать размещение вычислений. Покупка камер класса Verkada привязывает к облаку Verkada. Покупка открытых ONVIF-камер оставляет свободу. Принимайте архитектурное решение до решения о закупке.

4. Недооценивают объем хранилища на edge. Камера, пишущая 4 Мбит/с непрерывно, заполняет 4 ТБ за 90 дней. Либо подбирайте SD/NVMe соответствующего размера, либо проектируйте хранение по событиям с четкой политикой того, что считать событием.

5. Забывают, что AWS Panorama уходит. Если ваша текущая архитектура опирается на Panorama, у вас есть время до 31 мая 2026, чтобы мигрировать. Edge-native плюс Lambda или Fargate для оркестрации — самая чистая замена.

Какие KPI измерять

KPI качества. mAP детекции по каждому классу на вашем собственном валидационном наборе (не COCO). Частота смены ID у трекера. Ложные алерты на камеру в неделю — цель меньше 5 для здорового развертывания.

Бизнес-KPI. Стоимость одной камеры в месяц со всеми расходами. Время от алерта до подтверждения оператором (медиана должна быть меньше 30 с). Инциденты, которые система пропустила и которые сообщил клиент — эту цифру нужно снижать от квартала к кварталу.

KPI надежности. Аптайм edge (цель 99,9% на промышленных развертываниях). Среднее время восстановления после сбоя сети (цель <30 с за счет edge-буферизации). Доля клипов алертов, успешно синхронизированных в облако в течение 60 минут после генерации.

Когда edge брать НЕ нужно

Edge не подходит, когда сценарий принципиально требует межкамерного рассуждения с низкой задержкой — например, отслеживания интересующего лица в реальном времени по 50-камерному кампусу, где один edge-бокс не видит всего графа. Также не подходит, если у вас маленькая команда, меньше 10 камер и нет желания поддерживать прошивки. В таких случаях cloud SaaS вполне работоспособен; просто заложите риск привязки к вендору в трехлетний план.

Cloud-only ошибочен почти везде, кроме трендовой аналитики и SMB. Средний путь — гибрид — покрывает 80% серьезных продуктов видеонаблюдения в 2026 году.

Готовы проверить математику edge против cloud?

Расскажите количество камер, целевую задержку и бюджет. Мы накидаем гибридную архитектуру и оценку сроков — на agent engineering, поэтому быстрее, чем вы ожидаете.

Частые вопросы

Edge AI всегда дешевле cloud AI для видеонаблюдения?

Выше примерно 20 камер с непрерывными потоками — да: счет за трафик и облачный GPU обгоняет стоимость edge-железа за 12 месяцев. Меньше 10 камер с низкой загрузкой — cloud SaaS может выиграть по совокупной стоимости, потому что вы экономите на инженерных часах интеграции. Точка перехода чувствительна к битрейту, часам работы и тому, нужны ли вам алерты в реальном времени.

Сколько точности я теряю, квантуя YOLO в INT8 для edge-инференса?

При правильной калибровке на репрезентативных данных post-training INT8 обычно стоит 5–8% mAP. Quantization-aware training сводит это до 3% и меньше. Для классов видеонаблюдения (человек, машина, посылка, оружие) практическая частота детекции неотличима от FP32-модели.

Запрещает ли EU AI Act облачное распознавание лиц по записям видеонаблюдения?

Нет. Он относит удаленную биометрическую идентификацию в реальном времени к высокорисковому — ограниченному и сильно регулируемому, но не запрещенному полностью. Конкретные применения вроде распознавания эмоций на работе или в школах и нецелевого скрапинга записей видеонаблюдения и интернета для биометрических баз запрещены. Edge-обработка упрощает комплаенс, потому что исходные биометрические данные не покидают здание.

Какое железо взять для прототипа edge AI-видеонаблюдения?

Для одной-двух камер и быстрого прототипа NVIDIA Jetson Orin Nano Super (18 600 ₽) — самый простой старт: он крутит YOLOv8n на реальном фреймрейте, и вся цепочка тулов NVIDIA работает из коробки. Для плотных развертываний, где важны питание и тепло, модули Hailo-8 (11 200–15 000 ₽) дают больше инференса на ватт. Смарт-камеры (Hanwha Wisenet 9, Axis с ACAP) полностью убирают шаг интеграции.

Как уберечь edge-модели от дрейфа со временем?

Постройте пайплайн сбора сложных случаев. Когда edge-модель возвращает детекции с низкой уверенностью или когда оператор корректирует алерт, отправляйте этот кадр с метаданными в облако для переобучения. Переобучайте раз в квартал, валидируйте на отложенной выборке и катите обновления по воздуху. Без этого цикла ждите заметного роста ложных срабатываний через 12–18 месяцев.

Можно ли запустить vision-language model на edge для описания сцен?

Небольшие VLM (1–3 млрд параметров, квантованные) в 2026 году крутятся на Jetson AGX Orin и промышленных ПК верхнего сегмента. Для типичных развертываний на Orin Nano описание сцен через VLM лучше держать в облаке и запускать только по алертам — вам не нужно прогонять каждый кадр.

Чем заменить AWS Panorama после закрытия в мае 2026?

Прямой замены от AWS нет. Чистый путь миграции — кастомный edge-инференс (Jetson, Hailo или смарт-камеры) плюс облачный слой оркестрации на Lambda, Fargate или вашем собственном Kubernetes. Мы уже провели несколько таких миграций; архитектура очевидна, узкое место — сроки.

Сколько занимает кастомная гибридная разработка видеонаблюдения с Фора Софт?

Поскольку мы используем spec-driven agent engineering, рабочий пилот на 5–10 камер с edge-инференсом, пайплайном алертов и базовым облачным дашбордом обычно занимает 8–12 недель. Срок продакшен-развертывания зависит от количества камер, сертификаций и интеграций. Опишите задачу — и мы дадим конкретную цифру по телефону.

Что почитать дальше

Архитектура видеонаблюдения

YOLO + ByteTrack + BoT-SORT + DeepSORT — гайд 2026

Стек детекции и трекинга, который работает под капотом каждой edge AI-системы видеонаблюдения.

Приватность и доверие

Тренды AI-видеонаблюдения 2026: качество данных и этика

EU AI Act, GDPR и план работы с доверием в продуктах биометрического видеонаблюдения.

Мониторинг в реальном времени

Зачем использовать AI для детекции видеоаномалий

Гайд покупателя по ML-обнаружению аномалий на edge- и гибридных стеках.

AI-улучшение

Генеративный AI и контекстная видеоаналитика

От чистой детекции к пониманию намерений с помощью облачных VLM и рассуждения.

Инженерные практики

Real-time видеообработка с AI: лучшие практики

Архитектурные паттерны и бюджеты задержек по 625+ выпущенным видеопроектам.

Готовы проектировать гибридную архитектуру видеонаблюдения?

Ответ для серьезного AI-видеонаблюдения в 2026 — гибрид: edge для алерта, облако для инсайта, тонкий канал между ними. Edge выигрывает по задержке, трафику, приватности и автономности; облако выигрывает по межкамерному рассуждению, переобучению и долгосрочной аналитике. Чистое облако сжимается, чистый edge хрупок, а быстрее всего растут вендоры, выбравшие середину.

Если вы проектируете кастомный продукт AI-видеонаблюдения — сами технологии хорошо изучены. Сложность в том, чтобы подогнать их под количество камер, бюджет задержки, регуляторную экспозицию, реальное состояние сети и темп переобучения. Это и есть тот разговор, который мы ведем с потенциальными клиентами по телефону — принесите ограничения, а мы принесем архитектуру и оценку сроков.

Поговорите с командой, которая выпустила 600+ видео- и AI-продуктов

Edge-инференс, облачная оркестрация, OTA-обновления моделей, потоки данных, готовые к EU AI Act. Мы делаем это каждый день — и быстрее, чем вы ожидаете, благодаря agent engineering.