Главное

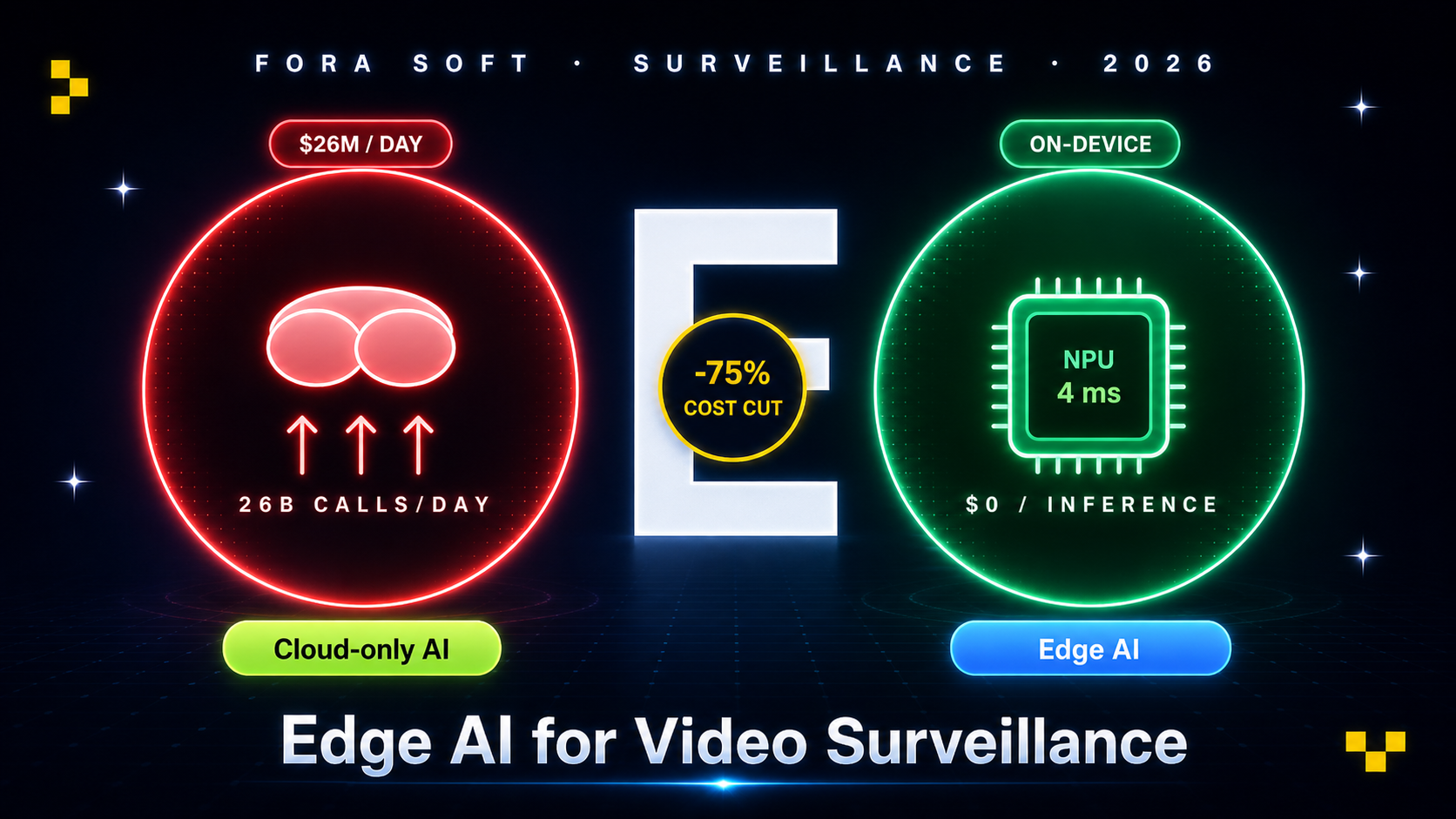

• Облачный инференс не выдерживает масштаб флота. 10 000 камер × 30 инференсов в секунду = 26 млрд вызовов API в сутки. Даже по 0,07 ₽ за вызов это 58 млн ₽ в месяц только за инференс. Edge AI крутит те же модели за стоимость железа камер плюс электричество.

• 4 мс на инференс на устройстве — реальная цифра. Современные NPU (Hailo-8, Coral TPU, Jetson Orin Nano) классифицируют кадр 1080p меньше чем за 5 мс. Детекция и трекинг на 30 fps в реальном времени, не покидая камеру.

• Экономия трафика — второй приз. Edge AI отправляет события, а не сырые кадры. Камера 24/7, которая выгружает только события движения, падает с ~1,5 ТБ/мес до ~30 ГБ/мес — в 50 раз меньше. Сильнее всего выигрывают сотовые флоты.

• YOLO26 в INT8-квантизации — рабочая лошадка. Детекция в реальном времени для людей, машин и аномалий на железе мобильного класса. Экспорт в CoreML, TFLite и ONNX покрывает Apple, Android и встраиваемый Linux.

• Приватность по умолчанию живёт на устройстве. Сырые кадры никогда не покидают камеру. В облако уходят только метаданные событий и снимки по запросу. С такой архитектурой соответствовать GDPR, CCPA и большинству регуляций по видеонаблюдению намного проще.

Почему этот плейбук написала Фора Софт

Фора Софт с 2005 года выпустила более 50 проектов в области видеонаблюдения и VMS (Video Management Systems). EyeBuild — солнечное AI-видеонаблюдение для строительных площадок и центральный пример этого гайда, VALT — система записи юридических заседаний более чем в 650 организациях США, Live Eye Surveillance, NetCamStudio, Mindbox и Doorbell App.

EyeBuild — нестандартный кейс: камеры на солнечных панелях с 4G/5G, без проводного интернета, выпускаются клиентом и работают полностью офлайн на батарее с автономностью 14 дней плюс 3 дня аварийного резерва. Детекция движения на базе ИИ крутится прямо на устройстве, потому что вы не сможете передать 4K@60fps по 4G и не сможете ждать 200 мс облачного round-trip, когда нарушители уже лезут через забор. Цифры в этом гайде взяты из этого продакшена и ещё четырёх проектов AI-видеонаблюдения, которые мы выпустили в 2024–2025.

Если вы строите или закупаете AI-видеонаблюдение и ваш флот переваливает за 50 камер, этот гайд расскажет, когда edge выигрывает, какой NPU выбрать, как доставлять YOLO26 на тысячи устройств и где обычно валятся подобные проекты.

Счёт за облачный инференс растёт быстрее флота?

Пришлите количество камер, частоту событий и текущий бюджет на облако. За 48 часов мы вернём одностраничный прогноз по реализации edge AI. Бесплатно.

Юнит-экономика, которая меняет расчёты

Облачные сервисы видеоаналитики (AWS Rekognition, GCP Vision, Azure Computer Vision) берут плату за каждый инференс. Цены разнятся, но реалистичный диапазон 2026 года для детекции объектов — 0,07–0,37 ₽ за вызов. На уровне флота арифметика рассыпается:

Флот из 10 000 камер по 30 инференсов в секунду. 10 000 × 30 = 300 000 вызовов в секунду = 26 млрд вызовов в сутки. По 0,07 ₽ за вызов — 1,9 млрд ₽ в день. Даже по 0,007 ₽ за вызов (объёмный тариф) — 195 млн ₽ в день. На таком масштабе подход «облачный API» структурно невозможен.

Сабсэмплинг помогает, но только до определённого предела. Большинство продакшен-деплоев не запускают инференс на каждом кадре. Они снижают частоту до 1–5 fps при движении и до 0,1 fps в простое. Даже на 1 fps в активном режиме флот из 10 000 камер выдаёт 10 000 инференсов в секунду, 864 млн в сутки — 6,4 млн ₽ в день по 0,007 ₽ за вызов. Всё равно нежизнеспособно.

На edge арифметика другая. Железо NPU стоит 3 750–22 500 ₽ на камеру (разово). Электричество для инференса — около 5–15 Вт на камеру, 375–1 125 ₽ в год. Маржинальная стоимость дополнительного инференса — ноль.

Трафик — вторая статья экономии. Камера 1080p H.264, работающая 24/7 на 4 Мбит/с, выгружает ~43 ТБ в год. С edge AI, который шлёт только события: ~360 ГБ в год. В 120 раз меньше. Для сотовых флотов (750–2 250 ₽ за ГБ) именно эта экономия становится главной.

Тиры железа — NPU, мобильные чипы, CPU

| Тир | Чипы | Стоимость на камеру | Возможности |

|---|---|---|---|

| Тир 1: NPU | Hailo-8, Google Coral, Jetson Orin Nano | 6 000–22 500 ₽ | YOLO26 на 30 fps в 1080p, несколько моделей |

| Тир 2: мобильные чипы | Snapdragon 8 Gen 1+, Apple ANE | 15 000–60 000 ₽ | Детекция и трекинг на уровне смартфона |

| Тир 3: средний SoC | Rockchip RK3588, Ambarella CV5 | 3 750–9 000 ₽ | Только лёгкая детекция |

| Тир 4: только CPU | Универсальный ARM Cortex-A | 750–3 000 ₽ | Детекция движения, базовая классификация |

Берите Тир 1 (NPU), когда: нужна детекция в реальном времени на 4K-потоках, несколько модельных голов (человек + транспорт + аномалии + лица) или высокая цена ошибки (охрана периметра, борьба с потерями в ритейле).

Берите Тир 2 (мобильные чипы), когда: «камера» на самом деле — это смартфон или планшет (приложение для охраны, нательная камера, мобильная инспекция). Apple ANE особенно силён в детекции объектов на 1080p.

Берите Тир 3 (средний SoC), когда: вы проектируете кастомную камеру по потребительским ценам (класс Wyze, Reolink). RK3588 — фактический стандарт для DIY и недорогого продакшена.

Берите Тир 4 (только CPU), когда: сценарий — это бинарная детекция движения и при этом флот огромный и чувствительный к цене. Лёгкое решение, которого хватает для ответа «происходит ли что-то?»

Выбор модели в 2026 году — YOLO26 и не только

YOLO26 (Ultralytics). Свежая модель из семейства YOLO, оптимизированная под мобильные NPU. Нативный экспорт в CoreML, TFLite и ONNX. Детекция объектов на 30+ fps на NPU Тира 1. Дефолт 2026 года для универсального видеонаблюдения.

Квантизованная YOLOv8/v9. Зрелая, поддержка широкого парка устройств. Точность ниже, чем у YOLO26, но примеров деплоя больше. Берите, когда нужно быстро запуститься, а тулчейн YOLO26 на вашем железе ещё сырой.

Детекция аномалий. Связка ResNet50 и автоэнкодера. Обучаете на «нормальной» съёмке, помечаете любое отклонение. Работает для нетипичных паттернов движения, оставленных предметов, попыток проникновения через периметр. Контролирует ложные срабатывания лучше правил-будильников.

Классификаторы людей и транспорта. Самая частая задача в видеонаблюдении. Отделить людей от животных (снизить ложные тревоги), классифицировать тип транспорта (грузовик или легковая для стройплощадок). MobileNetV3 или EfficientNet в INT8-квантизации справляются с этим на железе Тира 2–3.

Распознавание лиц. ArcFace или FaceNet в INT8. Здесь возникают вопросы приватности и регуляций — статья 9 GDPR относит биометрию к специальной категории данных. Обычно используется только для проверки по белому списку (например, корреляция с пропуском сотрудника) и крутится на NPU Тира 1.

Пайплайн деплоя — обучение, квантизация, OTA

1. Обучение в облаке. Тренируйте на размеченных данных флота с помощью PyTorch или TensorFlow. Активно используйте аугментации (освещение, погода, ракурсы) — так вы приблизите обучающую выборку к реальным условиям эксплуатации.

2. INT8-квантизация. Большинство NPU работают в INT8, а не в FP32. Post-training quantization (PTQ) быстрее, quantization-aware training (QAT) даёт более высокую точность. Целиться стоит в потерю точности менее 2 % относительно FP32.

3. Экспорт. CoreML — для iOS и Apple Silicon. TFLite — для Android и встраиваемого Linux. ONNX — для кросс-платформенной совместимости (у Hailo, Coral и Jetson есть ONNX-рантаймы). TensorRT — для максимальной производительности на NVIDIA Jetson.

4. OTA-доставка. Подпишите артефакт модели приватным ключом, загрузите в реестр моделей и раскатайте на флот через OTA-агента (Mender, Balena или собственный MQTT). Делайте поэтапную выкатку (canary → 10 % → 50 % → 100 %) с возможностью отката.

5. A/B-тесты в продакшене. Запустите новую модель на 5 % флота, логируйте события её решений и сравнивайте с контрольными данными (ручная проверка или теневой деплой доверенной модели). Промоутите до 100 % после 7–14 чистых дней.

6. Детекция дрейфа. Отслеживайте распределения уверенности инференса по каждой камере во времени. Резкие провалы средней уверенности сигнализируют о дрейфе данных — модель встретила условия, которых раньше не видела. Это триггер на дообучение.

Архитектура: edge ↔ VMS ↔ оповещения

Рисунок 1. Архитектура AI-видеонаблюдения на edge — камера, брокер, VMS, рассылка оповещений, тиры хранения.

Приватность и комплаенс — минимизация данных

1. Минимизация данных по GDPR — по умолчанию. Edge AI отправляет только метаданные событий, а не сырые кадры. Видео, которое всё-таки уходит наверх, передаётся по запросу, а действие оператора пишется в лог. Соблюдать статью 5 GDPR (минимизация данных, ограничение цели обработки) с такой архитектурой намного проще, чем когда всё хранится в облаке.

2. Маскирование PII прямо на устройстве. Лица и автомобильные номера можно размывать на камере до того, как кадр уйдёт куда-либо. Открытые маски (mask-rcnn, дообученный под лица) плюс эффекты на встроенном GPU делают это в реальном времени. Обязательно для ритейла, транспортных хабов и школ.

3. Аудит решений модели. Каждое оповещение должно фиксировать: какая модель, с какой уверенностью, по какому хешу входного кадра. Это нужно и для разбора инцидентов, и часто для юридической цепочки доказательств.

4. Осторожно с биометрией. Распознавание лиц подпадает под статью 9 GDPR (специальная категория данных). Многие юрисдикции ЕС требуют отдельной DPIA, публичного оповещения и ограниченных сроков хранения. Подумайте, действительно ли вам нужно сравнение лиц — обычно достаточно детекции человека.

5. Политики хранения, которые соблюдает само устройство. Кольцевые буферы на SSD камер автоматически перезаписывают старые записи. Тиринг облачного хранилища переводит видео в холодное хранилище через N дней и удаляет по истечении срока юридического хранения. Документируйте и доказывайте, что хранение ограничивается автоматически, а не вручную.

Мини-кейс: как EyeBuild доставляет ИИ на солнечные 4G-камеры

EyeBuild охраняет сотни строительных проектов с активами на миллиарды долларов. Камеры с питанием от солнечных батарей, автономностью 14 дней плюс 3 дня резерва, разрешение 4K UHD, без проводного интернета (аплинк 4G/5G), поворот и наклон на 360 градусов, два режима ночного видения (инфракрасный и цветной). Архитектура edge здесь не обсуждается: вы не сможете передать 4K@60fps по LTE и не будете ждать 200 мс облачного round-trip, когда нарушители уже лезут через забор.

Ключевые элементы архитектуры. Кастомное железо камеры с NPU Hailo-8, на котором крутится квантизованная YOLOv8, дообученная на снимках со строек (тяжёлая техника, каски, отделение людей в нерабочее время). Инференс — 4 мс на кадр в 1080p. Локальный SSD-кольцевой буфер хранит 14 дней нарезанных событий. В облако через 4G/5G уходят только снимки событий движения и 30-секундные клипы. Дашборд оператора работает в браузере; полное разрешение по запросу подтягивается отдельной выгрузкой.

Результат. Установка в день обращения. 18 600 ₽/мес за камеру по принципу «под ключ». Ежемесячные контракты без длинных обязательств. 30 дней облачного хранения включены. Трафик на камеру: ~2 ГБ/мес против ~600 ГБ/мес для сырого 4K-стриминга. Флот покрывает элитную жилую недвижимость, промышленные объекты, инфраструктуру и модульное строительство.

Что мы выпустили. Кастомную прошивку камер, пайплайн инференса на Hailo-8, инфраструктуру обучения моделей для постоянного улучшения флота, OTA-агента, облачную VMS, дашборд оператора и мобильное приложение. Свяжитесь с нами, если хотите аналогичный продукт для своего видеонаблюдения.

Делаете кастомную AI-камеру или VMS?

Мы выпустили EyeBuild, VALT и ещё четыре продакшен-системы AI-видеонаблюдения. Пришлите ТЗ — за 48 часов мы вернём одностраничную архитектуру и план на 16 недель.

Build vs buy — Axis, Hikvision, кастомный white-label

Готовые AI-камеры (Axis, Hikvision, Bosch, Hanwha). 30 000–150 000 ₽ за камеру. Преднатренированные модели на устройстве, VMS вендора. Подходит, когда вы используете камеры как клиент сервиса (охранная фирма, ритейлер) и вам не нужны кастомные модели или брендированное железо. Учтите: Hikvision и Dahua ограничены на федеральных рынках США.

White-label камеры с кастомной прошивкой. Заказываете железо у ODM (TVT, OEM Hikvision, универсальные ODM в Шэньчжэне) по 6 000–22 500 ₽ за камеру и заливаете собственную прошивку и ИИ-стек. Подходит, когда AI-функции — ваше преимущество, а железо вы продаёте клиентам (паттерн EyeBuild). Выше инвестиции в инжиниринг, зато полный контроль над интеллектуальной собственностью.

Платформа BYOC (bring-your-own-camera). Камеры принадлежат клиенту (он отдаёт RTSP-потоки), ИИ крутится на вашей платформе. Подходит, когда вы продаёте только софт, а у клиентов уже есть свои камеры. Edge-инференс здесь сложнее — обычно вы запускаете инференс в облаке или на on-prem GPU.

Модель затрат — облако vs edge

| Размер флота | Облако: годовая стоимость | Edge AI: годовая стоимость | Экономия |

|---|---|---|---|

| 100 камер | ~4,5 млн ₽ | ~1,8 млн ₽ (с учётом амортизации железа) | ~58 % |

| 1 000 камер | ~43 млн ₽ | ~13 млн ₽ | ~69 % |

| 10 000 камер | ~412 млн ₽ | ~105 млн ₽ | ~75 % |

| 100 000 камер | Структурно нежизнеспособно | ~825 млн ₽ | N/A |

Расчёт исходит из инференса на 30 fps, NPU стоимостью 3 750–9 000 ₽ за камеру с амортизацией на 5 лет, электричества на 375 ₽ в год, облачной VMS и оповещений на 375 ₽ за камеру в месяц, сотового трафика на 150 ₽/ГБ (где применимо). Для облачного варианта взято 0,03 ₽ за инференс (объёмный тариф), 24/7 с сабсэмплингом до 5 fps в активном режиме.

Фреймворк решения — выберите edge за пять вопросов

В1. Размер флота? Больше 50 камер — edge выигрывает по деньгам. Меньше 50 — облако может оказаться проще.

В2. Связь? Сотовая или нестабильный Wi-Fi → edge обязателен (трафик и надёжность). Гигабитный Ethernet по проводу → облако или гибрид допустимы.

В3. Чувствительный к задержке сценарий? Охрана периметра, детекция падения, обнаружение огня и дыма → нужен edge для отклика менее 100 мс. Общий мониторинг с оператором в цикле → облако подойдёт.

В4. Регулирование приватности? GDPR со строгими требованиями к локализации данных или чувствительный контент (школы, здравоохранение) → edge заметно проще.

В5. Кастомный или коммодити-ИИ? Вертикальные модели (стройка, потери в ритейле, здравоохранение) → делайте кастомную прошивку. Универсальная детекция людей и транспорта → готовых камер обычно достаточно.

Подводные камни, которых стоит избежать

1. Игнорировать OTA. Без надёжного OTA-пайплайна вы не сможете чинить баги моделей, выкатывать патчи безопасности и развивать продукт. Стройте OTA до раскатки на флот, а не после.

2. Закрывать глаза на дрейф моделей. Модель, обученная на летней съёмке, теряет точность зимой. Новые ракурсы, новое освещение, новые этапы стройки — всё это незаметно подъедает качество. Мониторьте распределения уверенности и переобучайте на регулярной основе.

3. Недооценивать поток оповещений. 10 тысяч камер генерируют столько тревог, что захлёбывается операторская команда. На таком масштабе нужны правила триажа, дедупликация оповещений и приоритизация на основе ML.

4. Ложные срабатывания, из-за которых операторы перестают реагировать. Если 30 % тревог — ложные, операторы перестанут их проверять. В первые 90 дней настраивайте под точность, а не под полноту; чувствительность будете повышать, когда доверие к системе уже сложится.

5. «Кирпичить» устройства неудачным OTA. Сбойное обновление прошивки на 10 тысячах устройств — катастрофа. Всегда запускайте canary-когорту, A/B по диапазонам серийных номеров и убеждайтесь, что откат работает, ещё до раскатки на весь флот.

KPI для измерения

Качество. mAP при IoU 0,5 на эталонном датасете (целевой показатель: 0,85+). Доля ложных срабатываний на камеру в день (целевой показатель: меньше 0,5). Задержка инференса p50 (целевой показатель: меньше 10 мс на Тире 1, меньше 50 мс на Тире 3). Стабильность средней уверенности во времени (тревога, если месячная средняя падает больше чем на 5 %).

Бизнес. Время оператора на камеру в день (целевой показатель: меньше 5 минут для флота от 100 камер). Годовая стоимость на камеру. Отток клиентов (качественная детекция радикально снижает churn).

Надёжность. Доступность флота камер (целевой показатель: 99,5 %). Доля успешных OTA (целевой показатель: 99,8 %). Трафик на камеру в месяц (тревога, если выше базового больше чем в 2 раза; это сигнал, что вместо событий в облако уходят сырые потоки). Распределение состояний питания (актуально для солнечных флотов).

Когда edge AI разворачивать НЕ стоит

Маленький флот (меньше 30 камер). Стоимость облачного инференса невелика, инвестиции в edge не окупаются. Берите AWS Rekognition или аналоги.

Разовый ретроанализ архива. Прогнать 6 месяцев записи в поисках одного события — облачный GPU-инференс эластично масштабируется, edge — нет.

Модели, которые меняются еженедельно. Если вы ещё итерируете ИИ-модель, OTA-цикл будет вас тормозить. Держите инференс в централизованной точке, пока модель не стабилизируется, и только потом переносите на edge.

Камеры, которыми вы не управляете. Если ваша платформа принимает RTSP-потоки от разнотипных сторонних камер, кастомную прошивку залить не получится. Инференс гоняйте на региональном GPU-кластере.

FAQ

Hailo-8 vs Coral TPU vs Jetson?

У Hailo-8 лучший показатель производительности на ватт — отлично подходит для камер на солнечных батареях. Coral TPU дешевле и хорошо поддержан экосистемой TensorFlow. Jetson Orin Nano — самый гибкий (полный Linux, более широкий стек ПО), но потребляет больше энергии. В EyeBuild мы используем Hailo-8 из-за ограничений по питанию.

YOLO26 или модель, обученная под задачу?

Преднатренированный YOLO26 закрывает ~80 % типовых сценариев видеонаблюдения (человек, транспорт, базовые объекты). Дообучайте YOLO26 на ваших данных для оставшихся 20 % — специфичные для стройки объекты, поведение в ритейле и так далее. Модель полностью с нуля редко когда нужна.

Как соблюдать GDPR при детекции лиц?

Избегайте распознавания лиц без явного бизнес-обоснования: детекция (есть ли лицо?) — более мягкая категория, чем распознавание (чьё это лицо?). Размывайте лица на устройстве для любого выгружаемого кадра. Нужно публичное оповещение. Подумайте, не достаточно ли вам детекции человека.

А ночное видение и плохая погода?

Обучайте на аугментированных данных: слабое освещение, дождь, туман. У части камер есть IR-cut фильтр, и ночью они переходят в ИК-режим. Модели надо учить и на видимых, и на ИК-кадрах; считайте их разными распределениями входа.

Как выкатывать модели по OTA?

Подпишите артефакт модели, раскатайте через OTA-агента (Mender, Balena или собственный MQTT), делайте поэтапную выкатку (canary → 10 % → 100 %) с проверкой здоровья на каждом шаге. Всегда закладывайте откат к последней рабочей версии. На устройстве резервируйте достаточно флеш-памяти под две версии модели.

Можно ли крутить несколько моделей на одной камере?

Да, на NPU Тира 1. Типичный паттерн: лёгкий детектор движения работает постоянно, более тяжёлый YOLO26 запускается по движению, опциональный детектор аномалий — периодически. Оркестрация нескольких моделей — стандарт для Hailo-8 и Jetson Orin Nano.

А что насчёт гибрида edge и облака?

Гибридный паттерн: edge делает быструю детекцию, облако получает метаданные событий и ключевые кадры и прогоняет более тяжёлую верифицирующую модель (на трансформерах) по подозрительным событиям, чтобы дополнительно срезать ложные срабатывания. Лучшее из двух миров, и трафика всё равно в 50 раз меньше, чем при стриминге всего подряд.

Сколько занимает разработка кастомной AI-камеры?

Прошивка, ИИ-пайплайн и облачная VMS для деплоя класса EyeBuild: 16–24 недели для v1 силами 2–4 сеньоров. Параллельный сорсинг железа добавит 8–12 недель, если идёте через ODM. Мы обычно укладываемся ближе к нижней границе диапазона за счёт переиспользования наработок Agent Engineering.

Что почитать дальше

ИИ

AI-детекция аномалий в видеонаблюдении

Сопутствующий материал по дизайну модели аномалий на автоэнкодере и ResNet.

VMS

Видеоаналитика и видеонаблюдение

Паттерны интеграции аналитических событий со стороны VMS.

Архитектура

Масштабируемая архитектура VMS

Облачная и on-prem архитектура VMS для больших флотов.

Сравнение

Edge AI и cloud AI — сравнение

Соседняя статья о бинарном выборе.

AI-инфра

MCP для видео и real-time приложений

Как добавить слой LLM-агента поверх вашей VMS.

Готовы запустить флот, который масштабируется?

Свыше 50 камер edge AI остаётся единственным экономически оправданным путём. Железо Hailo-8, Coral и Jetson в 2026 году уже зрелое; YOLO26 в INT8-квантизации закрывает большинство сценариев; OTA-инструменты (Mender, Balena, собственные решения) умеют сопровождать эволюцию флота. Сам паттерн хорошо изучен — инженерные риски лежат не в модели, а в операционном слое: оповещения, дрейф, сроки хранения, надёжность OTA.

Для сотовых флотов edge выигрывает уже на одной только экономии трафика (в 50 раз меньше). Для сценариев с высокой ценой ошибки edge выигрывает по задержке. Для деплоев, чувствительных к приватности, edge выигрывает за счёт минимизации данных. На стороне «только облака» остаются мелкие флоты и быстрые итерации модели.

Хотите план запуска edge AI на 16 недель для своего флота камер?

Пришлите целевой размер флота, условия эксплуатации и сценарии детекции. За 48 часов мы вернём одностраничную архитектуру, шортлист железа и план на 16 недель.